医学人工智能周刊 #2

Table of Contents

大型语言模型在医学和医学研究中的伦理问题 #

大型语言模型(LLM)是一种在大量文本数据中训练的深度学习模型,其目标是生成类似人类响应的新文本。2022年11月30日发布的基于大型语言模型的对话机器人ChatGPT(OpenAI, San Francisco, CA, USA),将大型语言模型推动到公众视野并且让数百万能够使用它进行试验。自从那时起,医学从业者和研究者就开始探索LLM的潜在应用,因为很多医学实践和研究都围绕着大量基于文本的任务,例如展示、发表、记录和报告。使用LLM来帮助和简化这些任务可以节约大量时间,让临床人员和研究者能进行其他工作。目前有许多在不同开发阶段的其他LLMs,包括BioGPT(MIT),LaMDA(Google),Sparrow(Deepmind AI),Pangu Alpha(Huawei),OPT-IML(Meta)以及Megataron Turing MLG(Nvidia)。一些新的变种,例如基于PubMed文献训练后专注于生物医学领域文本生产以及挖掘的BioGPT,可能对未来医学和医学研究有重大的影响。与任何新兴、颠覆式的技术一样,重要的是考虑使用中的伦理并优先考虑符合社会最佳利益的负责任和有益的应用。本文从偏见、信任、责任人、公平性以及隐私探讨了LLM在医学实践和研究中关键的伦理问题。

Ethics of large language models in medicine and medical research - The Lancet Digital Health

对可穿戴设备数据去隐私化是不是给我们一个虚假的安全感?系统综述 #

可穿戴设备让采集和分享个人数据变得更加容易,这篇系统综述调查来源于可穿戴设备的去隐私化数据是不是足以保护数据集中个体的隐私。通过文献综述,本文总结正确识别率约86%-100%,表明重新标识风险很高。(重新识别通常是将去标识化或者匿名的数据集与有标识化数据的数据集建立连接)而且,只需要1-300秒记录数据就可以从通常被认为不能产生标识化信息的传感器数据例如ECG进行重新标识化。该发现提醒重新思考数据分享的方法,在促进研究创新过程中,同时保护个人隐私。

特定时间和事件深度学习方法用于心肌灌注成像后个性化风险评估 #

心肌灌注成像(MPI)的标准临床解释已被证实对主要不良心血管事件(MACE)有预后价值。然而,对特定事件类型和时间间隔进行个性化预测具有挑战性。本文建立一个可解释的深度学习模型,该模型能够直接从MPI和15中临床特征中分别预测全因死亡、急性冠状动脉综合症和血管重建的特定时间风险。这种方法能将个体事件概率表示为时间的函数并且关注特定患者和特定事件的风险解释,这可能有助于引起人们对可改变风险因素的关注。该模型使用了DeepHit中架构以及修改后的损失函数,输出是一个3*131的2维矩阵分别代表了从0到每30天直到最长随访时间各事件发生的概率。

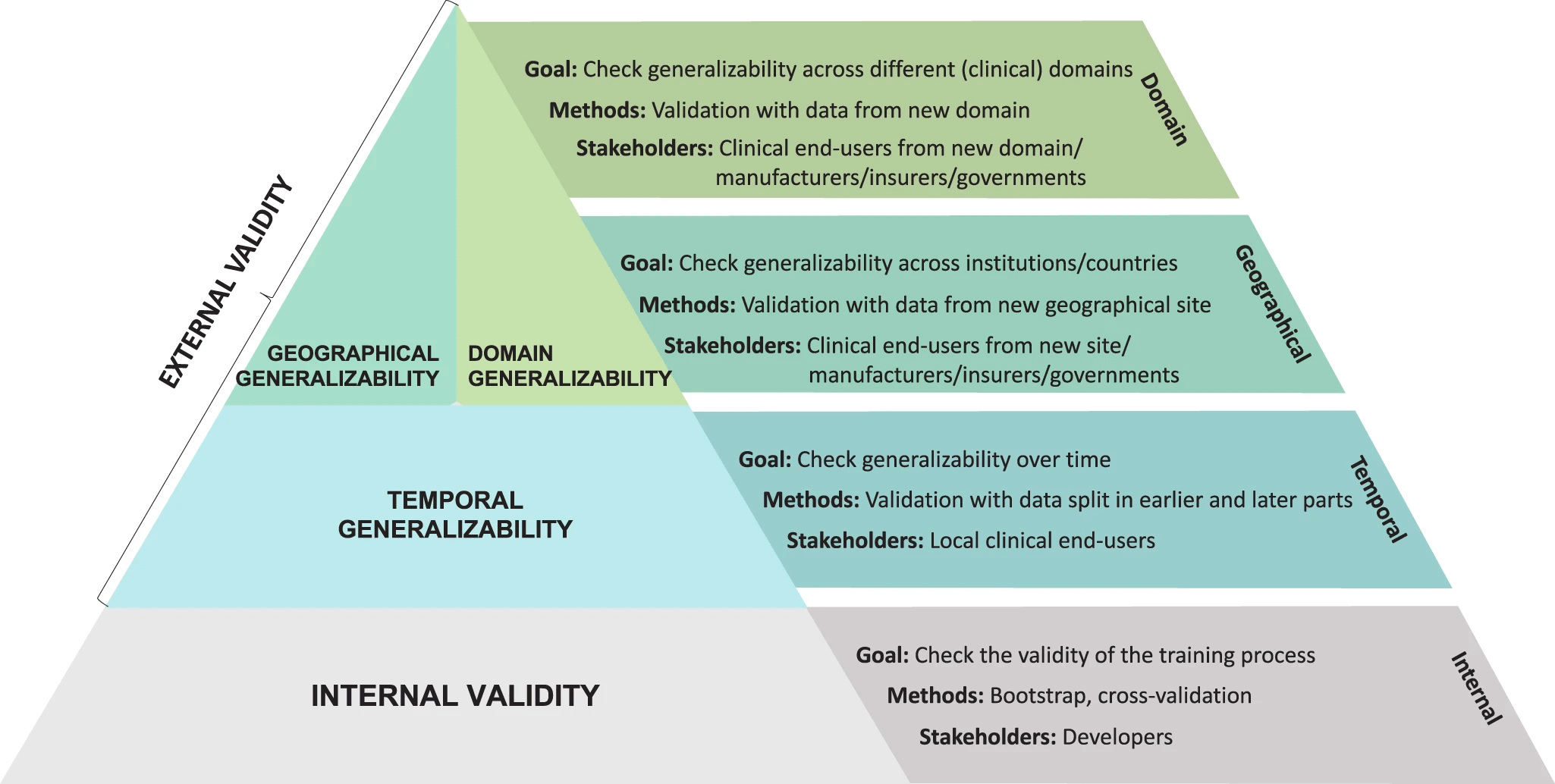

临床预测算法验证展望 #

临床预测算法的泛化性与临床实践应用十分相关。本文基于现有文献概述了三种类型的泛化性:时序,地理,和领域泛化,以及其目标、方法、利益相关方。

Perspectives on validation of clinical predictive algorithms | npj Digital Medicine